Umjetnu inteligenciju sad obučavamo dvostruko brže nego lani

Nova MLPerf ljestvica pokazuje pad vremena treninga, a dominirali su rezultati sustava izgrađenih pomoću Nvidia A100 GPU-a

Prema najboljim mjerama koje imamo, skupu mjerila pod nazivom MLPerf, sustavi strojnog učenja mogu se danas obučiti gotovo dvostruko brže nego lani. Ta brojka nadmašuje najoptimističnija očekivanja. Zasluge za to većinom idu softverskim i sistemskim inovacijama, a ove smo godine dobili i prvi uvid u to što mogu neki novi procesori, posebice oni iz Graphcorea i Intelove podružnice Habana Labs.

Problem vremena potrebnog da se neuronska mreža osposobi za obavljanje svoje zadaće pokrenuo je startupe poput Cerebrasa koji je postavio rekord za najveće UI modele trenirane na jednom uređaju ili SambaNove te natjerao tvrtke poput Googlea da sami razvijaju čipove za ubrzavanje strojnog učenja. Ali novi podaci MLPerf pokazuju da je skraćeno vrijeme obuke za standardne neuronske mreže.

Nvidijin Hopper

MLPerf, ili "olimpijada strojnog učenja", sastoji se od osam referentnih testova: prepoznavanja slike, segmentacije medicinske slike, dvije verzije detekcije objekta, prepoznavanja govora, obrade prirodnog jezika, preporuka i podržanog učenja.

Računala i softver 21 tvrtke i institucije natječu se na bilo kojem ili svim testovima. Ovaj put, pod službenim nazivom MLPerf Training 2.0, poslali su 250 rezultata, a vrlo malo komercijalnih i cloud sustava testirano je na svih osam testova.

Kao i obično, dominirali su rezultati sustava izgrađenih pomoću Nvidia A100 GPU-a. Nvidijina nova GPU arhitektura Hopper dizajnirana je s arhitektonskim značajkama usmjerenim na ubrzavanje treninga.

Trostruko poboljšanje

Googleov TPU v4 nudi trostruko poboljšanje u proračunima po vatu u odnosu na prethodnika. Dva njegova testa napravljena su korištenjem sustava "full TPU v4 pod" koji se sastoji od 4096 čipova, za ukupno do 1,1 milijardu milijardi operacija u sekundi.

U tom opsegu, sustav je prošao kroz treninge prepoznavanja slike i obrade prirodnog jezika za nešto više od 10 sekundi svaki. A kako se radi o usluzi u oblaku, Googleov sustav strojnog učenja dostupan je diljem svijeta. Strojevi se nalaze u Oklahomi, gdje je izgrađen podatkovni centar koji radi na 90 posto energije bez ugljika.

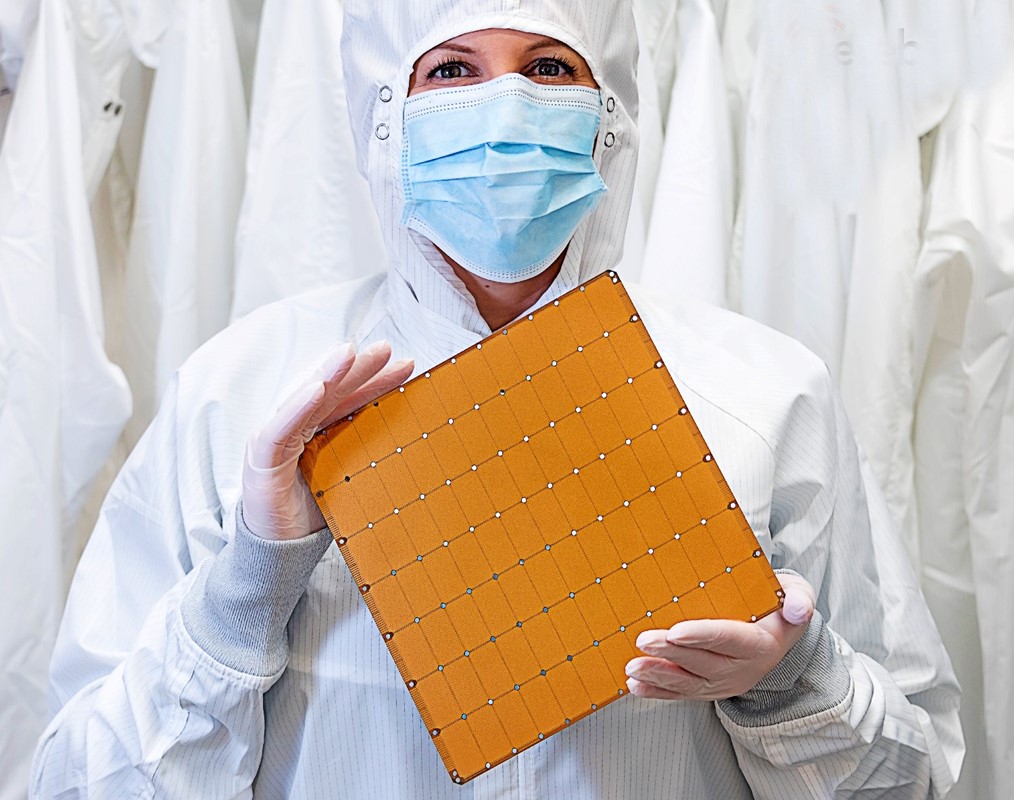

Novi Bow IPU

Graphcore je predstavio prve rezultate performansi računala napravljenih s novim Bow IPU-om. Bow je prvi komercijalni procesor izgrađen slaganjem dvije silikonske pločice jedne na drugu. U svojoj trenutnoj iteraciji, jedan od čipova u nizu radi do 40 posto brže koristeći čak 16 posto manje energije u usporedbi s prethodnikom.

MLPerf 2.0 bio je prva prilika da se vidi kako se to prenosi na stvarne neuronske mreže. Čipovi nisu razočarali, pokazujući ubrzanje od 26 do 31 posto u prepoznavanju slike i povećanje od 36 do 37 posto kod obrade prirodnog jezika. Graphcore planira IPU u kojem oba čipa u 3D skupu izvode računalstvo. Takav budući procesor bio bi spojen u superračunalo Good Computer s 8192 IPU-a, sposobno upravljati neuronskim mrežama koje su najmanje 1000 puta veće od današnjih najvećih jezičnih modela.

Sve rezultate testova možete pronaći ovdje i na stranici IEEE Spectruma.