EfficientViT: računalni vid visoke rezolucije

MIT-ov sustav poboljšava kvalitetu slike u video streamingu i pomaže autonomnim vozilima da prepoznaju opasnosti na cesti u stvarnom vremenu

Autonomna vozila moraju brzo i točno prepoznati objekte s kojima se susreću, a u tome im pomažu moćni modeli računalnog vida za kategorizaciju svakog piksela na slici visoke rezolucije. Suvremeni modeli semantičke segmentacije izravno uče interakciju između svakog para piksela na slici, tako da njihovi izračuni rastu kvadratno s povećanjem rezolucije slike. Iako su točni, ovi su modeli zbog toga prespori za obradu slika visoke razlučivosti u stvarnom vremenu na rubnom uređaju poput senzora ili mobilnog telefona.

Devet puta brži

No sad su istraživači s MIT-a razvili EfficientViT, učinkovitiji model koji uvelike smanjuje računsku složenost semantičke segmentacije i omogućava rad u stvarnom vremenu na uređaju s ograničenim hardverskim resursima, kao što su ugrađena računala koja autonomnom vozilu omogućuju donošenje odluka u djeliću sekunde.

Testiranje modela na skupovima podataka korištenim za semantičku segmentaciju otkrili su da EfficientViT radi do devet puta brže na Nvidijinoj grafičkoj procesorskoj jedinici (GPU) od ostalih popularnih modela transformatora vida, s istom ili boljom točnošću.

Globalno receptivno polje

Kategoriziranje svakog piksela na slici visoke rezolucije koja može imati milijune piksela težak je zadatak za transformatore vida koji su izvorno razvijeni za obradu prirodnog jezika. Oni svaku riječ u rečenici kodiraju kao token, a zatim generiraju mapu koja bilježi međusobne odnose svakog tokena i pomaže modelu razumjeti kontekst prilikom predviđanja.

Koristeći isti koncept, transformator vida sjecka sliku na dijelove piksela i kodira svaki mali dio u token prije generiranja karte. Prilikom generiranja model koristi funkciju sličnosti koja izravno uči interakciju između svakog para piksela. Tako model razvija globalno receptivno polje, što znači da može pristupiti svim relevantnim dijelovima slike.

Prilagođavanje hardveru

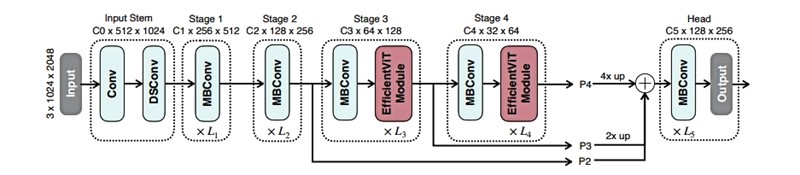

EfficientViT zamjenjuje funkciju nelinearne sličnosti linearnom funkcijom. Tako može preurediti redoslijed operacija kako bi smanjili ukupne izračune bez promjene funkcionalnosti i gubitka globalnog receptivnog polja. Arhitektura EfficientViT-a se prilagođava hardveru, što olakšava rad na različitim vrstama uređaja poput naglavnika za virtualnu stvarnost ili edge računala u autonomnim vozilima.

"Sad možemo dobiti najbolje od oba svijeta i smanjiti računalstvo kako bismo ga učinili dovoljno brzim da ga možemo pokrenuti na mobilnim uređajima i uređajima u oblaku", kažu istraživači koji ovom tehnikom žele ubrzali generativne modele strojnog učenja, poput onih koji se koriste za generiranje novih slika. Također žele nastaviti povećavati EfficientViT za druge zadatke vida i poboljšati kvalitetu slike u videoigrama.