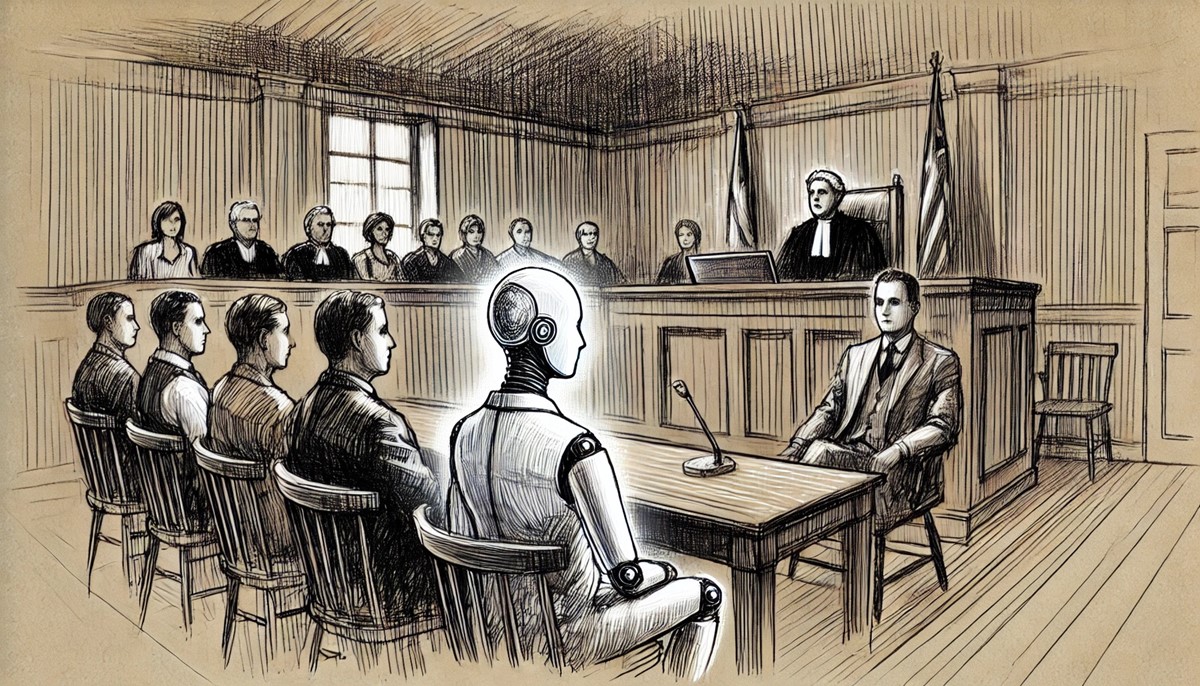

Umjetna inteligencija u sudnici - kad preminuli progovore

Umjetna inteligencija omogućila je žrtvi da "progovori" na izricanju kazne svom ubojici, otvarajući važna pitanja o budućnosti sudskih postupaka...

Prošlog tjedna u Arizoni osuđenik za ubojstvo iz nehaja čuo je svjedočenje svoje žrtve – muškarca koji je bio mrtav više od dvije godine. Pedesetčetverogodišnjak Gabriel Paul Horcasitas dobio je maksimalnu kaznu od 10 i pol godina zatvora zbog ubojstva Christophera Pelkeya tijekom incidenta prometne agresije u studenom 2021. Ono što je ovom izricanju kazne dalo novu dimenziju bila je odluka suca Todda Langa da dopusti obraćanje AI generiranoj verziji Pelkeya sudu.

Digitalni glas iz prošlosti

AI reprodukcija uključivala je Pelkeyevo lice, tijelo i realističan glas koji se obratio njegovom ubojici riječima: "Gabrielu Horcasitasu, čovjeku koji me upucao: šteta što smo se sreli tog dana u tim okolnostima. U nekom drugom životu, vjerojatno bismo mogli biti prijatelji. Vjerujem u oprost."

Ovu tehnološku prezentaciju nije iniciralo tužiteljstvo, već Pelkeyeva obitelj. Njegova sestra Stacey Wales i njezin suprug, oboje stručnjaci za AI, razvili su ideju samo nekoliko tjedana prije drugog suđenja. Presuda s prvog suđenja bila je poništena kada je sudac presudio da tužiteljstvo nije pravovremeno otkrilo potencijalno ključne dokaze.

"Ono što sam imala reći nije mi se činilo dovoljno za posljednju osobu koja donosi odluku o Chrisovom životu," objasnila je sestra Wales nakon što je provela dvije godine pokušavajući sastaviti izjavu o utjecaju na žrtvu. Zanimljivo je da je obiteljska kreacija zagovarala oprost umjesto maksimalne kazne.

Pravna valjanost pod povećalom

AI prezentacija stvorila je ono što odvjetnik obrane Jason Lamm naziva "jakim razlogom za žalbu." Lamm je doveo u pitanje je li prezentacija prešla etičke granice: "Žalbeni sud morat će odlučiti je li ovo bila pogreška, je li jednostavno previše izvan granica u smislu da je upalna i u kojoj mjeri se sudac oslonio na to." Unatoč izricanju maksimalne kazne, sudac Lang je priznao oprost izražen u AI prezentaciji, napominjući: "Osjećam da je to bilo iskreno, da njegov očiti oprost Horcasitasu odražava karakter o kojem sam čuo o Pelkeyu danas."

Etička pitanja digitalnog svjedočenja

Gary Marchant, profesor prava na Državnom sveučilištu Arizona, koji se specijalizirao za etiku i nove tehnologije te je član odbora Vrhovnog suda koji savjetuje o upotrebi AI-ja, izrazio je zabrinutost zbog ovog presedana.

"Obitelj je stvarno dobro predstavila ono što bi on rekao, i oni bi najbolje znali što bi rekao," napomenuo je Marchant. "Ali s druge strane, to je potpuno lažno, zar ne? Nije istinito." Ovaj slučaj postavlja važna pitanja o autentičnosti u sudskim postupcima. "Vidite nekoga tko govori, a zapravo ne govori, zar ne? Vidite tu osobu u sudnici kako zapravo govori, a u stvarnosti, ona je mrtva i ne govori," naglasio je Marchant. "Ovo je dodatni korak za koji smatram da će nas dovesti na opasan teren."

Dolazi li digitalno pravosuđe?

Pelkeyev slučaj uvodi složene scenarije za buduća suđenja. Bi li okrivljenici mogli stvoriti AI verzije sebe koje predstavljaju alternativne narative? Bi li tužitelji mogli generirati žrtve koje traže oštrije kazne nego što bi one same htjele? Kako će porote razlikovati između autentičnog svjedočenja i tehnološki poboljšanih izjava? Slučaj Horcasitas predstavlja početak ponovnog promišljanja o tome kako definiramo svjedočenje, utjecaj na žrtve i samu pravdu u doba umjetne inteligencije.