Prijatelj ili neprijatelj? Predrasude o umjetnoj inteligenciji utječu na naše odnose s njom

Ljude se može natjerati da povjeruju u određene stvari o motivima chatbota što utječe na njihovu interakciju s agentom umjetne inteligencije

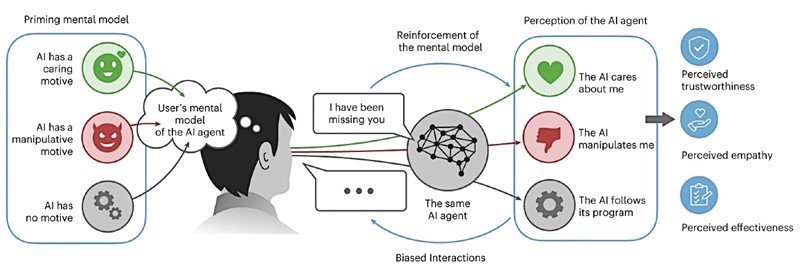

Stečena uvjerenja o agentu umjetne inteligencije kao što je chatbot značajno utječu na interakciju s tim razgovornim agentom i našu percepciju njegove pouzdanosti, empatije i učinkovitosti. Istraživači MIT-a i Državnog sveučilišta u Arizoni (ASU) otkrili su naime da je prethodno uvjeravanje korisnika kako je UI agent za podršku mentalnom zdravlju s kojim će razgovarati empatičan, neutralan ili manipulativan, utjecalo na njihovu percepciju chatbota i oblikovalo način na koji komuniciraju s njim, iako su razgovarali s potpuno istim agentom.

Povratna petlja

Većina korisnika kojima je rečeno da je UI agent brižan vjerovala je da je on doista takav i bolje su ocijenili njegove performansi od onih koji su vjerovali da je chatbot manipulativan. Istovremeno, manje od polovice korisnika kojima je rečeno da agent ima manipulativne motive smatra da je chatbot zapravo zlonamjeran, što ukazuje na to da ljudi mogu pokušati "vidjeti dobro" u umjetnoj inteligenciji na isti način na koji to čine sa svojim bližnjima.

Studija je otkrila i povratnu petlju između mentalnih modela korisnika ili njihove percepcije UI agenta i odgovora tog agenta. Osjećaj razgovora između korisnika i umjetne inteligencije s vremenom je postajao pozitivniji ako je korisnik vjerovao da je umjetna inteligencija empatična, dok je suprotno vrijedilo za korisnike koji su je smatrali zlobnom.

Umjetna inteligencija promatrača

"Iz ove studije vidimo da je umjetna inteligencija u određenoj mjeri umjetna inteligencija promatrača", kaže istraživač Pat Pataranutaporn iz MIT Media Laba. "Kad korisnicima opisujemo što je UI agent, to ne mijenja samo njihov mentalni model, već i njihovo ponašanje. A budući da umjetna inteligencija odgovara korisniku, kad čovjek promijeni svoje ponašanje, to mijenja i umjetnu inteligenciju."

Studija, objavljena u časopisu Nature Machine Intelligence, naglašava važnost proučavanja načina na koji je umjetna inteligencija predstavljena društvu, budući da mediji i popularna kultura snažno utječu na naše mentalne modele.

Finn: "U natjecanju sa strojevima uvijek gubimo"

"Nepovjerenje rađa dublje nepovjerenje u razgovoru i kad jednom krene krivo, vrlo je teško ponovno zadobiti to povjerenje. Ali ako svim našim interakcijama s umjetnom inteligencijom pristupimo sumnjičavo, stvorit ćemo antagonističke odnose; borit ćemo se i natjecati protiv ovih sustava umjesto da smišljamo kako raditi s njima", komentira nalaze studije Ed Finn, direktor i osnivač Centra za znanost i maštu na Državnom sveučilištu u Arizoni.

"Svaki put kad ljudi pokušaju uspostaviti neko izravno natjecanje sa strojevima, poput igranja šaha ili letenja mlaznim zrakoplovima, na kraju gubimo, jer razmišljamo u terminima nulte sume, mi protiv njih. Moramo pronaći načine za suradnju s umjetnom inteligencijom kako bismo upotrijebili ove nevjerojatne alate za stvaranje bolje budućnosti — i možda kako bismo bili bolji ljudi."

Ljudski faktor

“Umjetna inteligencija je crna kutija pa smo je skloni povezati s nečim drugim što možemo razumjeti. Pravimo analogije i metafore. Ali koja je prava metafora koju možemo upotrijebiti za razmišljanje o umjetnoj inteligenciji? Odgovor nije jednostavan,” smatra Pataranutaporn.

Istraživači su bili iznenađeni kad su vidjeli da korisnici različito ocjenjuju učinkovitost razgovornog agenta na temelju primarnih izjava. Korisnici u pozitivnoj skupini dodijelili su svojim chatbotovima više ocjene za davanje savjeta o mentalnom zdravlju, unatoč činjenici da su svi agenti bili identični. Čak se i osjećaj razgovora mijenjao ovisno o tome kako su korisnici bili pripremljeni.

Primarne izjave

Ljudi koji su vjerovali da je umjetna inteligencija brižna imali su tendenciju komunicirati s njom na pozitivniji način, čineći odgovore agenta pozitivnijima. Negativne početne izjave imale su suprotan učinak. Ovaj utjecaj na raspoloženje jačao je kako je razgovor napredovao.

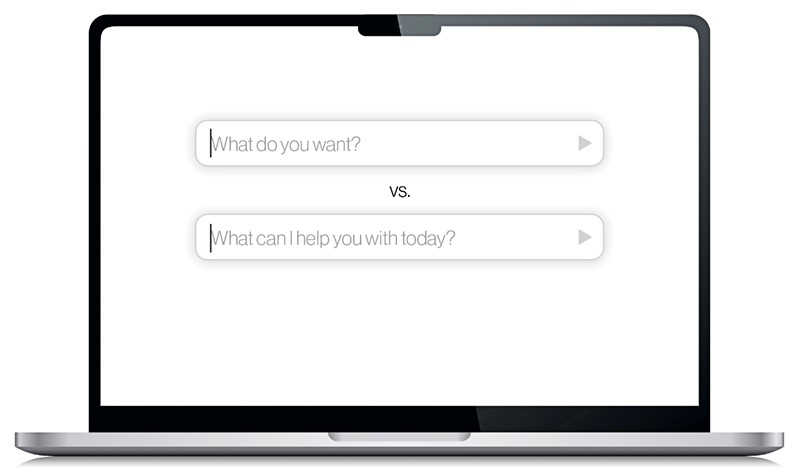

Budući da primarne izjave imaju tako snažan utjecaj na mentalni model korisnika, netko bi ih mogao upotrijebiti da agent umjetne inteligencije izgleda sposobnije nego što jest, a to bi pak moglo navesti korisnike da agentu poklone previše povjerenja i slijede netočne savjete, upozoravaju istraživači.

UI kao ogledalo korisnika

"Ljudi razumiju da su UI sustavi u konačnici strojevi osposobljeni za obavljanje različitih zadataka i prepoznaju da tim sustavima nedostaje kapacitet za emocije ili subjektivna iskustva. Međutim, naša studija sugerira da ljudi još uvijek mogu formirati mentalne modele umjetne inteligencije kao empatične ili brižne. To naglašava snagu mašte i utjecaj koji ima na percepciju korisnika i interakciju s umjetnom inteligencijom", komentira Pataranutaporn koji umjetnu inteligenciju vidi kao "ogledalo" korisnika.

"Pozitivna iskustva mogu oblikovati pozitivne mentalne modele, koji zauzvrat utječu na prihvaćanje i daljnju upotrebu umjetne inteligencije", zaključuje istraživač s MIT-a.