Olimpijske igre u Parizu bit će veliki prodajni sajam sigurnosne opreme

Uoči ovogodišnjih igara na snagu stupa privremeni zakon o korištenju automatiziranog nadzornog sustava koji će pokrivati sve događaje, cijelo olimpijsko selo, pristupne ceste i željeznice

Tko je malo bolje pratio natjecanja trkača na skijama na Zimskim olimpijskim igrama u Pekingu 2022. mogao je primijetiti niz tornjeva duž stazekoji su skupljali valne duljine diljem spektra i pretraživali podatke u potrazi za znakovima sumnjivog kretanja. Bio je to dio eksperimenta nadzora temeljenog na Internetu stvari.

Masovni nadzor vođen umjetnom inteligencijom

Ovog ljeta na Olimpijskim igrama u Parizu sigurnosne će službe izvesti puno veći eksperiment koji će pokrivati sve događaje, cijelo olimpijsko selo i pristupne ceste i željeznice, najavljuje IEEE Spectrum. I sve to bit će u skladu s privremenim zakonom koji automatiziranim nadzornim sustavima omogućava otkrivanje "unaprijed određenih događaja" koji bi mogli dovesti do terorističkih napada.

"Masovni nadzor vođen umjetnom inteligencijom opasan je politički projekt koji bi mogao dovesti do širokih kršenja ljudskih prava. Svaka radnja u javnom prostoru bit će uvučena u mrežu nadzorne infrastrukture, potkopavajući temeljne građanske slobode", bune se aktivisti Amnesty Internationala. Običan svijet nije toliko zabrinut. Dapače, u okrugu Seine-Saint-Denis objeručke su prihvatili uvođenje sustava videonadzora pokretanog umjetnom inteligencijom koji će detektirati i izdavati kazne za bacanje smeća.

Gomila pod prismotrom

"Nadzor nije monolitan koncept. Nisu svi protiv nadzora", objašnjava antropolog Matheus Viegas Ferrari, autor opsežne studije o nadzoru na Olimpijskim igrama u Parizu. Problem dakako nije u izdavanju kazni za ostavljanje psećeg izmeta na cesti, nego u mogućnosti da sustav nadzora kažnjava jedne više nego druge jer njegov algoritam daje prednost jednoj boji kože ili stilu odijevanja u odnosu na drugu. Europska unija razrađuje detalje zakona o umjetnoj inteligenciji, a loša provedba takvih mjera koje se tiču socijalne skrbi već je srušila jednu europsku vladu, onu nizozemsku.

Privremeni zakon o nadzoru prestaje važiti u ožujku 2025. i inzistira na tome da algoritmi pod njegovom nadležnošću ne obrađuju biometrijske podatke i ne implementiraju tehnike prepoznavanja lica niti se podaci smiju međusobno usklađivati i automatski povezivati s drugim obradama osobnih podataka. No, nigdje ne piše da se tehnologija nadzora gomile ne može prodati dobrom ponuđaču.

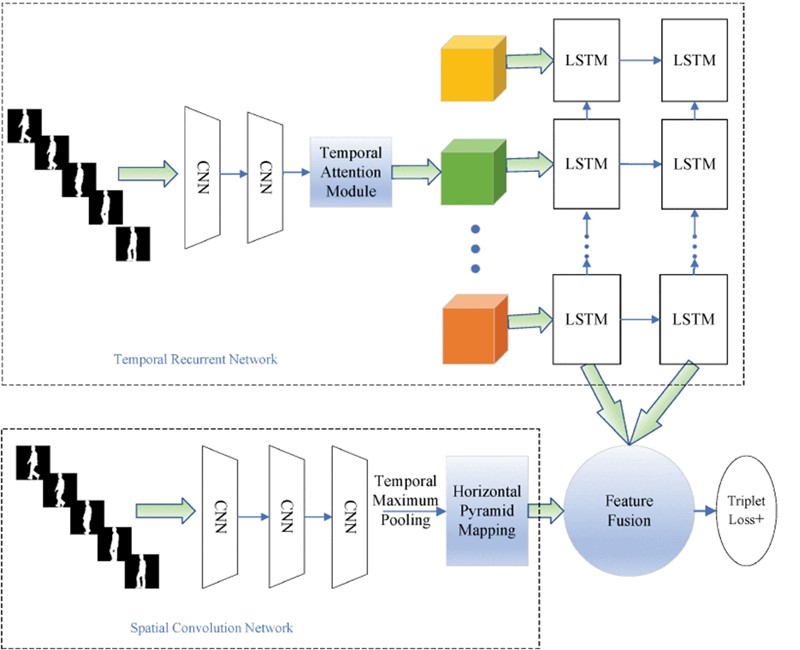

Trening neuronskih mreža

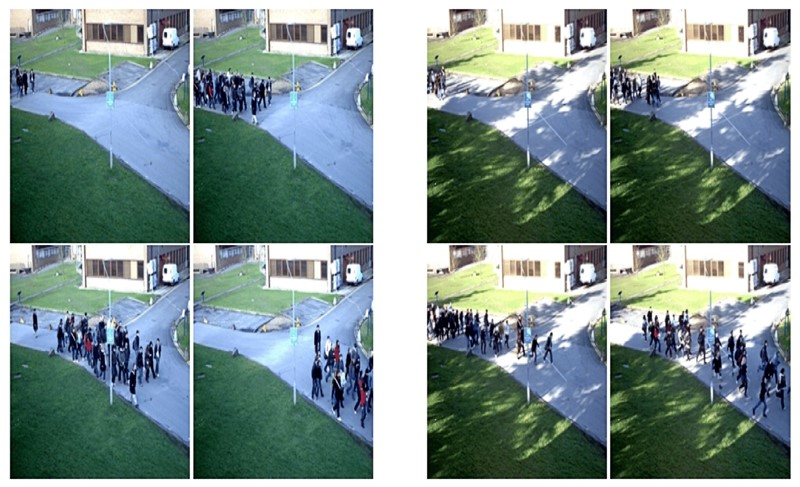

Riječ je o tehnologiji čija upotreba seže u sada već daleku prošlost i uz čiju su pomoć proučavani mnogi aspekti ponašanja gomile; čak se koristila i za sprečavanje kokoši da se međusobno poubijaju. A da bi ste nadzirali gomilu, ne morate identificirati ljude, tvrdi Jonathan Weber sa Sveučilišta Haute-Alsace u Mulhouseu, jedan od autora pregleda postojećih video analiza mase. Programeri neuronske mreže mogu trenirati na oblicima nalik ljudima i potom prijeći na sofisticiranije obrasce, kao što su ljudi koji padaju, trče, tuku se, svađaju ili nose noževe.

"Upozorenja se ne temelje na biometrijskim podacima nego na položaju osobe", objašnjavaju šefovi Videticsa, tvrtke uključene u nadzor Olimpijskih igara u Parizu. Oni otprije izrađuju softver koji detektira padove u zgradama ili ilegalno odlaganje otpada na otvorenom, bez identifikacije pojedinaca.

Analiza gomile

Zagovornici ljudskih prava strahuju da bi iskrivljeni podaci o obuci mogli dovesti do problema s upotrebom umjetne inteligencije za analizu gomile. Pritom se pozivaju na primjer usporedbe fotografija 28 američkih kongresnika s portretima uhićenika, kad je softver nesrazmjerno češće osobe tamnije puti registrirao kao kriminalce.

No, čak i ako programeri sastave dovoljno stvarnog ili simuliranog videa lošeg ponašanja da uvježbaju svoje algoritme bez pristranosti, još uvijek ostaje pitanje što učiniti sa svim tim prikupljenim podacima iz stvarnog svijeta.

Prodajni sajam

Neke tvrtke zbog toga koriste alate za zamućivanje lica kako bi smanjile mogućnost curenja osobnih podataka, drugi predlažu tehniku snimanja videa izravno iznad glave, kako bi se izbjeglo snimanje lica ljudi. Neki pak razvijaju alate za prepoznavanje pojedinaca ili barem njihovo razlikovanje od drugih u videu koristeći analizu hoda. No, ova tehnika nije u skladu s privremenim "olimpijskim" zakonom.

Organizatori često olimpijske igre tretiraju kao svojevrsni sajam sigurnosne tehnologije, pa je za očekivati da bi se to moglo ponoviti i nakon Pariza. Čak i ako Francuska prestane koristiti svoje algoritme za obradu videa na javnim mjestima nakon isteka zakona, druge ih zemlje mogu kupiti od francuskih tvrtki za svoju domaću upotrebu. Tako su Ekvador i neke druge zemlje kupile su od Kineza opremu za nadzor temeljenu na sustavima prikazanim na Olimpijskim igrama 2008. u Pekingu. Ne postoji razlog da se to ne ponovi i nakon Pariza.